文章导读

当你在为复杂的天气预测、金融市场分析焦头烂额,依赖耗能巨大的经典超级计算机时,是否想过算力的天花板远不止于此?中国科学家刚刚在实验室里,用仅仅9个量子比特的“微型大脑”,完成了一项颠覆性任务:其预测精度直接媲美了拥有1万个节点的庞大经典神经网络。这背后的关键,并非依赖脆弱且难以操控的深度量子线路,而是巧妙利用了量子系统里两个曾被视作“缺陷”的特性——自旋间的相互作用与不可避免的弛豫过程。这项被称为“量子储层计算”的实验,首次将量子优势从理论基准推向了真实世界的时间序列预测,但它究竟如何绕过了当前量子硬件最大的噪声障碍?这个答案,可能正重新定义AI算力的未来格局。

— 内容由好学术AI分析文章内容生成,仅供参考。

近日,中国科学技术大学自旋磁共振实验室彭新华教授、李兆凯副研究员与复旦大学李晓鹏教授等人合作,在量子机器学习实验领域取得重要突破。团队提出了一种基于关联量子自旋系统的新型量子储层计算方法,并通过实验首次证明,在处理真实世界的时间序列预测任务时,量子机器学习的性能可以超越经典神经网络模型。相关研究成果于2026年3月25日以“High-Accuracy Temporal Prediction via Experimental Quantum Reservoir Computing in Correlated Spins”为题在线发表于《物理评论快报》(Physical Review Letters)。

量子计算被广泛认为是突破经典计算局限、解决复杂问题的重要途径。近年来,量子计算已在若干特定基准问题上展现出超越经典方法的优越性,但如何将这种优势拓展到具有现实意义的实际任务,仍是当前国内外亟待解决的关键问题。特别是,许多量子算法依赖精密设计的复杂量子线路实现,而在当前含噪声中等规模量子(NISQ)设备上,这类深层线路往往受到操作误差累积、相干时间有限等实验条件制约,导致面向实际应用的量子优势难以真正落地。

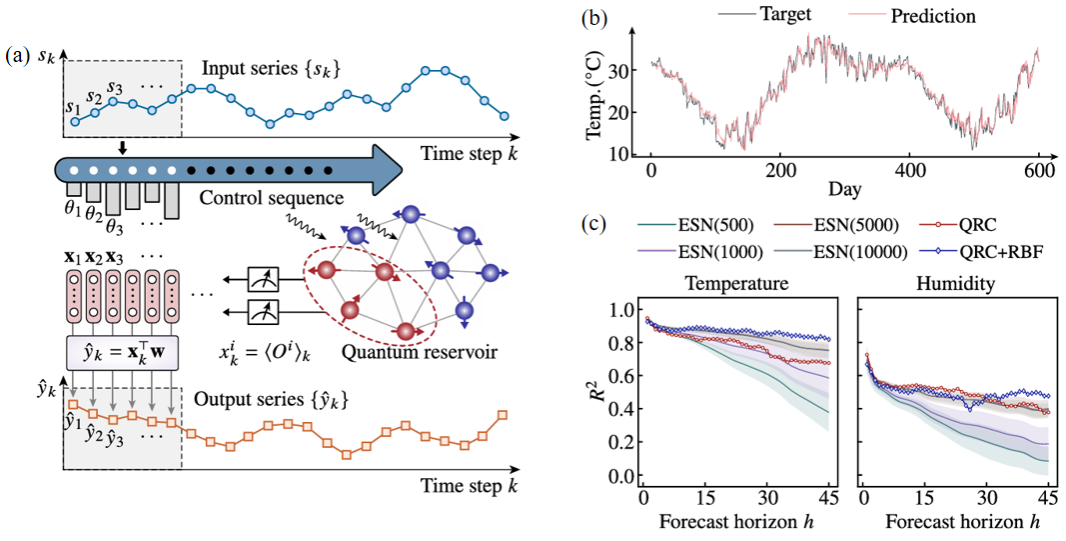

为克服上述挑战,研究团队基于量子储层计算(quantum reservoir computing)这一机器学习框架,通过协同利用自旋相互作用与弛豫过程以及引入时间复用测量两项关键创新,提出并实验实现了一种适用于自旋体系的时序信息处理新方案。在该方案中,时序信号通过射频脉冲编码到高维量子态中,借助自旋网络内禀的纠缠动力学进行信息处理,无需人为构造复杂量子线路,从而显著降低实验调控难度。同时,团队将通常被视为负面因素的弛豫过程转化为可利用的计算资源,为处理时序信息提供了必要的短期记忆能力。此外,时间复用测量在不增加额外硬件负担的情况下显著提高了信息提取效率,进一步释放小规模量子系统的计算潜力。

图:(a) 量子储层计算示意图;(b) 单步气温预测实验结果;(c) 经典网络与量子储层在多步预测中的性能对比。

基于这些创新,研究团队在核磁共振(NMR)量子平台上构建了由9个耦合自旋组成的量子储层系统(由13C 标记巴豆酸分子中的4个碳核和5个氢核构成)。在常用的NARMA时序基准测试中,实验结果达到了现有量子实验中的最优水平,预测误差较此前结果降低了1至2个数量级。进一步地,在更具现实意义的多步天气预测任务中,研究团队构建的9自旋量子储层展现出卓越的预测能力,其精度能够达到甚至超越10000节点经典储层网络的水平。这一结果首次在实验上表明,量子机器学习在现实任务上能够超越大规模的经典网络模型,突破了相关研究长期停留于数值模拟和合成数据验证的局限,被审稿人评价为“量子机器学习领域的重要里程碑”。该研究为发展低能耗、高维度、面向真实场景的量子人工智能提供了切实可行的实验范式,也为探索 NISQ 时代量子技术的实用化开辟了新方向。

我校博士生侯彦君、华骏铖为论文共同第一作者。该研究得到了科技部、国家自然科学基金委等项目的支持。

论文链接:https://journals.aps.org/prl/abstract/10.1103/r8ww-qw7j

(物理学院,科研部)

© 版权声明

本文由分享者转载或发布,内容仅供学习和交流,版权归原文作者所有。如有侵权,请留言联系更正或删除。

这个9自旋系统真能比10000节点经典网络还强?求大佬科普下具体咋实现的

太贵了吧这也,NMR平台普通人哪玩得起😂