大连理工大学软件学院、国际信息与软件学院科研团队在大模型量化、图神经网络领域取得突破成果

近日,软件学院、国际信息与软件学院科研团队在大模型量化、图神经网络等领域取得重要进展。两项成果被数据挖掘国际顶级会议——知识发现与数据挖掘会议(ACM SIGKDD Conference on Knowledge Discovery and Data Mining,简称KDD)录用。同时,关于图神经网络领域的成果荣获2024年度“中国计算机学会自然科学二等奖”。

SEPTQ:简单有效的大语言模型后训练量化范式(SEPTQ: A Simple and Effective Post-Training Quantization Paradigm for Large Language Models)

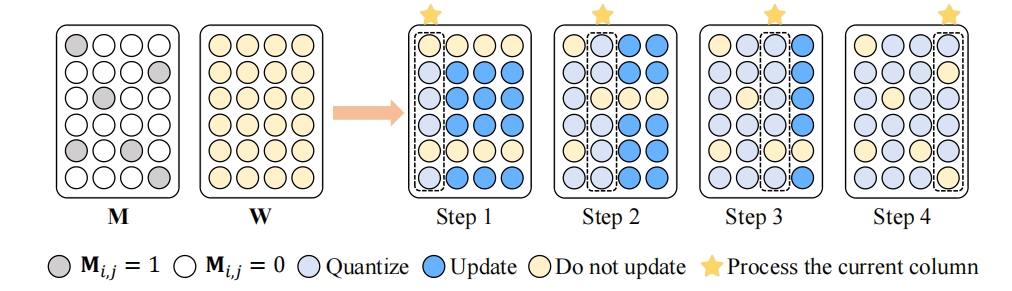

该成果由我校刘晗副教授、2024级硕士研究生高浩天、张晓彤副教授、2024级博士研究生李长雅,北京大学张枫博士,深圳北理莫斯科大学王伟教授,宾夕法尼亚州立大学马凤龙助理教授,我校于红副教授共同完成。大型语言模型量化技术迅速发展,但在低比特量化设置下保持性能和计算效率方面仍存在挑战。文章提出了一种新颖的后训练量化范式(SEPTQ),通过静态全局策略确定量化位置,并利用掩码矩阵指导量化和更新相关权重,以精确补偿量化权重的舍入误差。实验结果表明,SEPTQ在不同量化位级的大型语言模型上显著优于其他强基线方法,特别是在低比特量化场景下,展现出卓越的性能和鲁棒性。

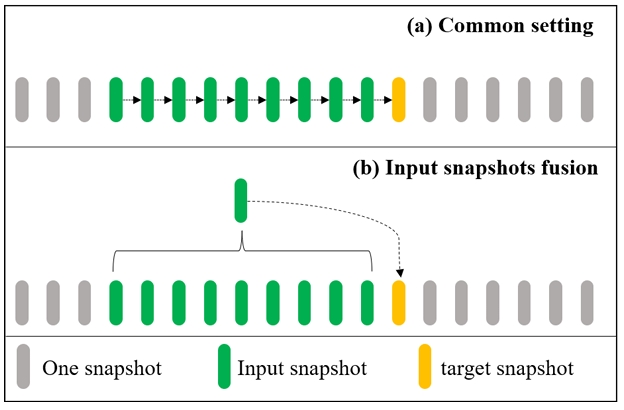

基于快照融合的动态图神经网络(Input Snapshots Fusion for Scalable Discrete-Time Dynamic Graph Neural Networks)

该成果由之江实验室亓庆国博士、陈红阳研究员,宾夕法尼亚州立大学程黾昊助理教授,刘晗副教授共同完成。动态图表示学习快速发展,但离散时间动态图在时间边研究和大规模计算上仍面临挑战。文章提出了基于快照融合的动态图神经网络(SFDyG),通过结合霍克斯过程与图神经网络,降低计算复杂度并提升未来交互预测准确性。实验结果表明,SFDyG在多数据集上的性能优于现有方法,展现出高效性和准确性。

图神经网络的内在机理及其应用研究(2024年度CCF科技成果奖—自然科学二等奖)

该成果由香港理工大学吴晓明副教授,我校张晓彤副教授、刘晗副教授,香港理工大学李其迈博士共同完成。项目揭示了图神经网络中图卷积的本质是拉普拉斯平滑,具有低通滤波作用,证明了过多的卷积层数会导致特征过度平滑,为后续研究发挥图神经网络的潜力和规避风险提供了理论指导,并利于设计符合具体应用场景的新型图神经网络算法。

成果背景介绍:

知识发现与数据挖掘会议(ACM SIGKDD Conference on Knowledge Discovery and Data Mining,简称KDD)是数据挖掘领域最权威的顶级国际学术会议,是中国计算机学会推荐的A类学术会议(CCF A类会议)。中国计算机学会(CCF)科技成果奖旨在表彰在计算机科学、技术或工程领域具有重要发现、发明、原始创新,并在相关领域产生一定国际影响的优秀成果。在2024年度的自然科学奖评选中,全国共计产生一等奖3项、二等奖5项、三等奖2项。

来源:软件学院、国际信息与软件学院

编辑:李梦瑶 常思萌

© 版权声明

本文由分享者转载或发布,内容仅供学习和交流,版权归原文作者所有。如有侵权,请留言联系更正或删除。

相关文章

暂无评论...